NVIDIA为什么要造超级计算机DGX-1?

- 高端制造

- 2024-11-10 11:16:30

- 78

在今年硅谷的GTC上,NVIDIA发布了深度学习超级计算机DGX-1。黄仁勋称它是“装进机箱里的数据中心”。DGX-1内置了8块基于Pascal架构的TeslaP100加速器和4块1.92TB的固态硬......

在今年硅谷的GTC上,NVIDIA发布了深度学习超级计算机DGX-1。黄仁勋称它是“装进机箱里的数据中心”。

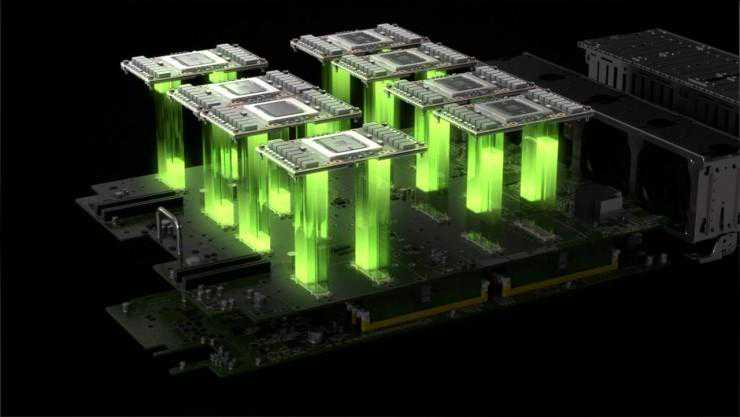

DGX-1内置了8块基于Pascal架构的TeslaP100加速器和4块1.92TB的固态硬盘,使用比传统PCIe快5-12倍的NVLink技术连接CPU与GPU以及GPU之间的数据传输。在深度学习训练上,它比一台普通的XeonE52697v3的双CPU服务器快75倍,整体性能相当于250台普通x86服务器。单台DGX-1的售价是12.9万美金。

在GTC之后,黄仁勋亲自将第一台DGX-1送给了ElonMusk的人工智能项目OpenAI。NVIDIA还会将首批DGX-1优先发给近年对人工智能有突出贡献的研究机构,这个名单里包含了Stanford、UCBerkeley、CMU、MIT、香港中文大学等等。而在中国大陆,已经公开的信息是7月份海康威视通过曙光签下了国内第一单DGX-1;NVIDIA方面则告诉我们目前DGX-1在国内已有十来家客户。

在10月份刚刚结束的HPCChina2016上,我们和NVIDIA的高层聊了聊他们在高性能计算上的看法以及他们为什么要造这台超级计算机。

下一代程序大部分会由机器编写NVIDIA负责解决方案与工程架构的副总裁MarcHamilton在HPCChina2016上表达了这么一个观点,AI会催生一种新的计算模型,未来大部分程序不会是由人来编写,而是通过深度学习网络来编写。

DGX-1是一种傻瓜式的设计DGX-1的设计可以回溯到2015年的GTC,当时NVIDIA公布了最新一代的Pascal架构,这一新架构会把一些关键的深度学习应用提升10倍以上的速率。但这一新架构也带来了新的问题:开发/研究人员可能要花数周甚至数月的时间配置这些GPU。所以在几个月后,黄仁勋在内部提出了一个要求:希望在第二年的GTC之前,由NVIDIA的工程部门打造一台基于Pascal架构的服务器,这样研究机构和公司们只要按下机箱按钮就能把8块GPU用在深度学习。

今天我们看到的DGX-1并不是8块GPU捏在一起那么简单。MarcHamilton告诉我们,DGX-1还囊括了3类软件和服务的整合。

当下,对NVIDIA来说,最大的挑战是如何快速普及深度学习,其中国区企业事业部总经理沈威说,深度学习是一个独特的市场,NVIDIA自己造DGX-1则是这个背景下的新尝试。MarHamilton

要实现150个petaflop浮点计算的性能,如果基于多个GPU的话,需要3400个服务器,而如果使用传统x86的解决方案,则需要10万个服务器。对于程序员来说,维护这两个数量级的服务器,选择是显而易见的。

本文链接:https://goko.jsntrg.cn/711071669360.html